Si vous avez encore peur que Google pénalise vos contenus parce qu'une IA les a touchés, cet article va vous contrarier. Depuis fin 2022, une panique sourde parcourt les équipes marketing : et si Google détectait le contenu IA ? Et si nos articles étaient pénalisés ? Et si tout notre investissement éditorial était réduit à néant par un algorithme ?

À retenir : Google ne cherche pas à savoir qui a écrit un contenu. Il cherche à savoir si ce contenu est utile. Les données montrent que 96,6% des premiers résultats contiennent des traces de contenu assisté par IA.

Ce guide fait le tri entre les mythes, les faits vérifiables et les stratégies qui fonctionnent réellement en 2026.

1. Ce que Google a vraiment dit : chronologie des positions officielles

Avant d'interpréter, revenons aux déclarations de Google. La chronologie est éclairante :

| Date | Événement | Implication |

|---|---|---|

| Avril 2022 | John Mueller : « Le contenu auto-généré est considéré comme spam » | Position historique, pré-ChatGPT |

| Février 2023 | Google publie ses guidelines : « Rewarding high-quality content, however it is produced » | Changement majeur : la qualité prime sur la méthode |

| Septembre 2023 | Google retire « written by people » des critères de recherche utile | L'auteur (humain ou IA) n'est pas le critère |

| Mars 2024 | Core Update + Spam Update : ciblage du « scaled content abuse » | La cible = production massive de faible qualité |

| 2025-2026 | SpamBrain évolue, AI Overviews se généralisent | Google utilise lui-même l'IA pour générer des réponses |

Le point clé : en moins de deux ans, Google est passé de « le contenu IA est du spam » à « peu importe qui écrit, pourvu que ce soit utile ». Ce pivot n'est pas anodin, c'est un virage stratégique.

La raison est pragmatique. Google ne peut pas pénaliser l'IA quand 96,6% des premiers résultats de recherche contiennent des traces de contenu assisté par IA (Originality.ai, 2024). Pénaliser l'IA reviendrait à vider son propre index.

2. Pourquoi la détection IA est un non-sujet

Les détecteurs ne fonctionnent pas

C'est l'éléphant dans la pièce. Les outils de détection IA — GPTZero, Originality.ai, Turnitin — sont présentés comme des gardiens fiables. Les données racontent une autre histoire :

| Problème | Donnée | Source |

|---|---|---|

| Faux positifs sur non-natifs | 61% des textes d'étudiants non-natifs anglophones flaggés comme « IA » | Stanford, 2023 |

| Contournement trivial | La paraphrase ou le remaniement humain suffit à tromper les détecteurs | Multiple studies |

| Seuil de fiabilité | Aucun détecteur ne dépasse 80% de précision en conditions réelles | TechPolicy.press |

| Biais linguistique | Les textes formels et techniques sont systématiquement sur-détectés | GPTZero disclosure |

En résumé : un détecteur qui se trompe une fois sur cinq dans le meilleur des cas n'est pas un outil fiable. C'est un générateur de faux positifs.

Google ne s'en sert pas

Google l'a confirmé à plusieurs reprises : il n'utilise pas de détecteur IA dans son algorithme de ranking. Danny Sullivan (Google Search Liaison) a été explicite : « Il n'y a pas de pénalité pour le contenu IA. Il y a une pénalité pour le contenu inutile. »

Ce n'est pas de l'altruisme. C'est du pragmatisme :

- Google produit lui-même du contenu IA (AI Overviews, Gemini)

- Les détecteurs sont trop imprécis pour un moteur qui traite des milliards de pages

- La qualité du contenu est un signal bien plus fiable que son origine

SpamBrain cible la médiocrité, pas la technologie

SpamBrain, le système anti-spam de Google, ne cherche pas de « watermarks IA ». Il détecte des signaux de basse qualité :

- Production massive sans revue éditoriale (scaled content abuse)

- Contenu copié-collé ou reformulé sans valeur ajoutée

- Pages sans expertise, créées uniquement pour capter du trafic

- Réseaux de sites automatisés (PBN, parasite SEO)

Un article rédigé avec l'aide d'un LLM, puis enrichi avec des données propriétaires, relu par un expert et structuré pour répondre à une intention de recherche réelle ? SpamBrain n'y verra rien d'anormal — parce qu'il n'y a rien d'anormal.

3. Ce que Google mesure vraiment

L'utilité avant tout

Les Quality Rater Guidelines (version septembre 2025) utilisent le concept de « helpful content » comme critère central. Un contenu utile :

- Répond à l'intention de recherche de l'utilisateur

- Apporte une valeur que les autres résultats ne fournissent pas

- Est suffisamment approfondi pour satisfaire le besoin informationnel

- Est présenté de manière claire et accessible

E-E-A-T : le filtre qualité

Le framework E-E-A-T (Experience, Expertise, Authoritativeness, Trustworthiness) est le filtre par lequel Google évalue la crédibilité d'un contenu. Il ne mesure pas comment le contenu a été produit, mais qui le publie et pourquoi il mérite la confiance.

Un contenu IA qui démontre de l'expertise (données sourcées, auteur identifié, expérience terrain) passera le filtre E-E-A-T. Un contenu 100% humain mais générique, sans source et sans auteur, ne le passera pas.

Les signaux comportementaux

Google utilise également les signaux d'engagement post-clic :

- Temps passé sur la page : un contenu qui retient = un contenu utile

- Pogo-sticking : un retour rapide vers les résultats = contenu insatisfaisant

- Taux de rebond contextuel : acceptable pour une FAQ, problématique pour un guide

- Clics suivants : navigation vers d'autres pages du site = signal de qualité

Ces signaux sont agnostiques de la méthode de production. Ils mesurent le résultat, pas le process.

4. Le vrai risque : le « scaled content abuse »

Si l'IA en soi n'est pas un problème, son utilisation massive et irresponsable l'est. La March 2024 Spam Update a introduit la notion de « scaled content abuse » — et c'est là que les lignes rouges sont claires.

Ce qui est ciblé

| Pratique | Pourquoi c'est ciblé | Exemple |

|---|---|---|

| Production massive sans revue | Aucune valeur ajoutée humaine | 500 articles/mois sur des sujets aléatoires |

| Contenu générique reformulé | Pas d'information nouvelle | Résumés automatiques d'articles existants |

| Pages créées pour le trafic | Intention manipulatrice | Pages affiliées auto-générées |

| Réseaux de sites automatisés | Manipulation de l'autorité | PBN alimentés par IA |

Ce qui n'est PAS ciblé

- L'utilisation de l'IA comme assistant de rédaction (structuration, reformulation, correction)

- La génération de premiers jets ensuite enrichis par un expert

- L'optimisation sémantique assistée par IA

- L'analyse de données et la suggestion de sujets

La frontière est nette : l'IA comme outil ≠ l'IA comme stratégie. Utiliser l'IA pour produire mieux est encouragé. Utiliser l'IA pour produire plus sans valeur ajoutée est pénalisé.

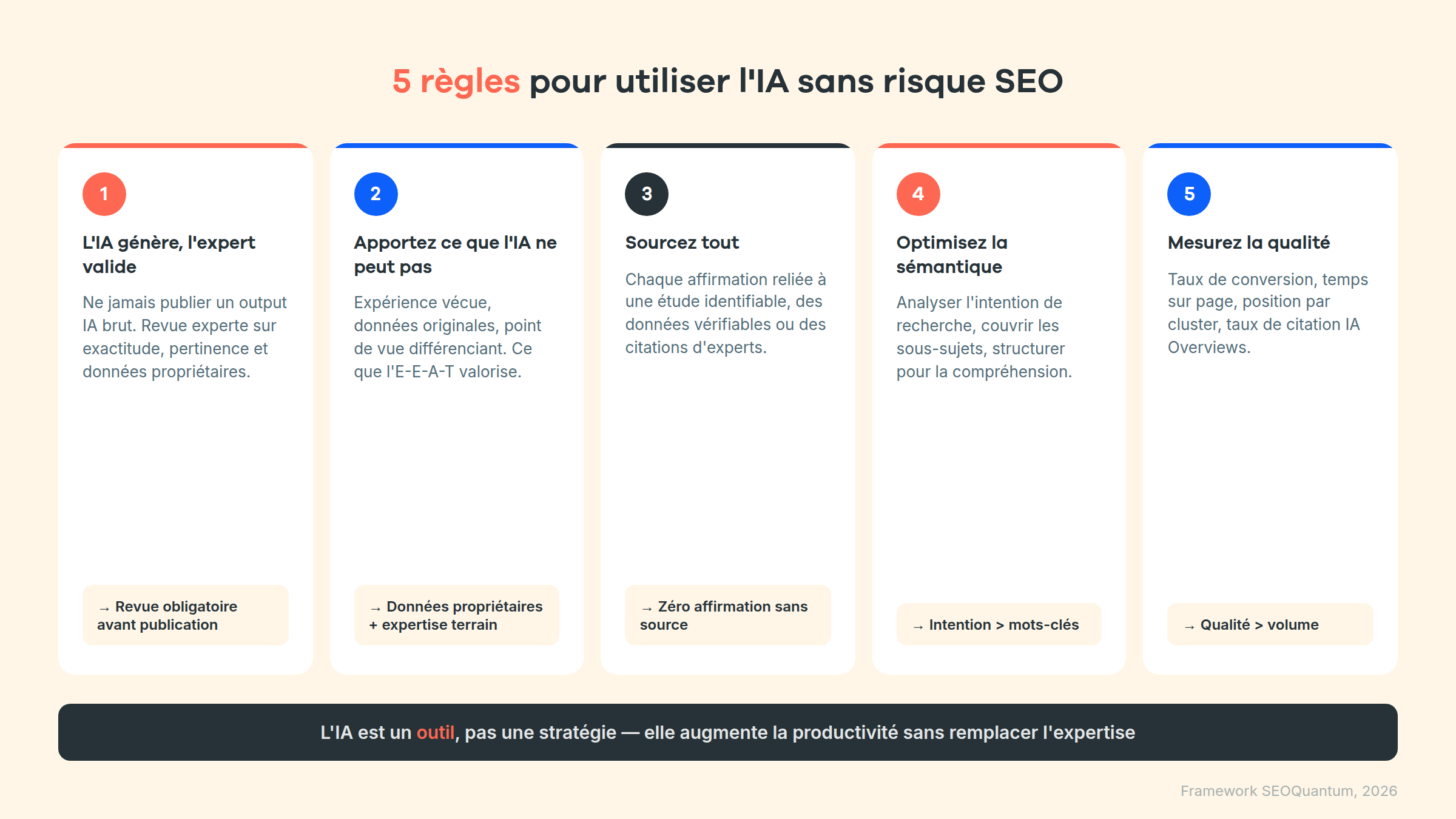

5. Framework : 5 règles pour utiliser l'IA sans risque SEO

Règle 1 — L'IA génère, l'expert valide

Ne publiez jamais un output IA brut. Chaque contenu doit passer par une revue experte qui vérifie :

- L'exactitude factuelle (les LLM hallucinent)

- La pertinence par rapport à l'intention de recherche

- L'ajout de données propriétaires ou d'expérience terrain

Règle 2 — Apportez ce que l'IA ne peut pas produire

L'IA excelle à synthétiser l'existant. Elle ne peut pas :

- Partager une expérience vécue (études de cas, retours terrain)

- Produire des données originales (enquêtes, tests, référentiels)

- Offrir un point de vue différenciant (opinion argumentée, analyse critique)

Ces éléments sont exactement ce que l'E-E-A-T valorise.

Règle 3 — Sourcez tout

Un contenu sans source est un contenu suspect — qu'il soit humain ou IA. Chaque affirmation factuelle devrait être reliée à :

- Une étude identifiable (auteur, date, méthodologie)

- Des données publiques vérifiables (Google Search Console, outils tiers)

- Des citations d'experts nommés

Règle 4 — Optimisez la sémantique, pas les mots-clés

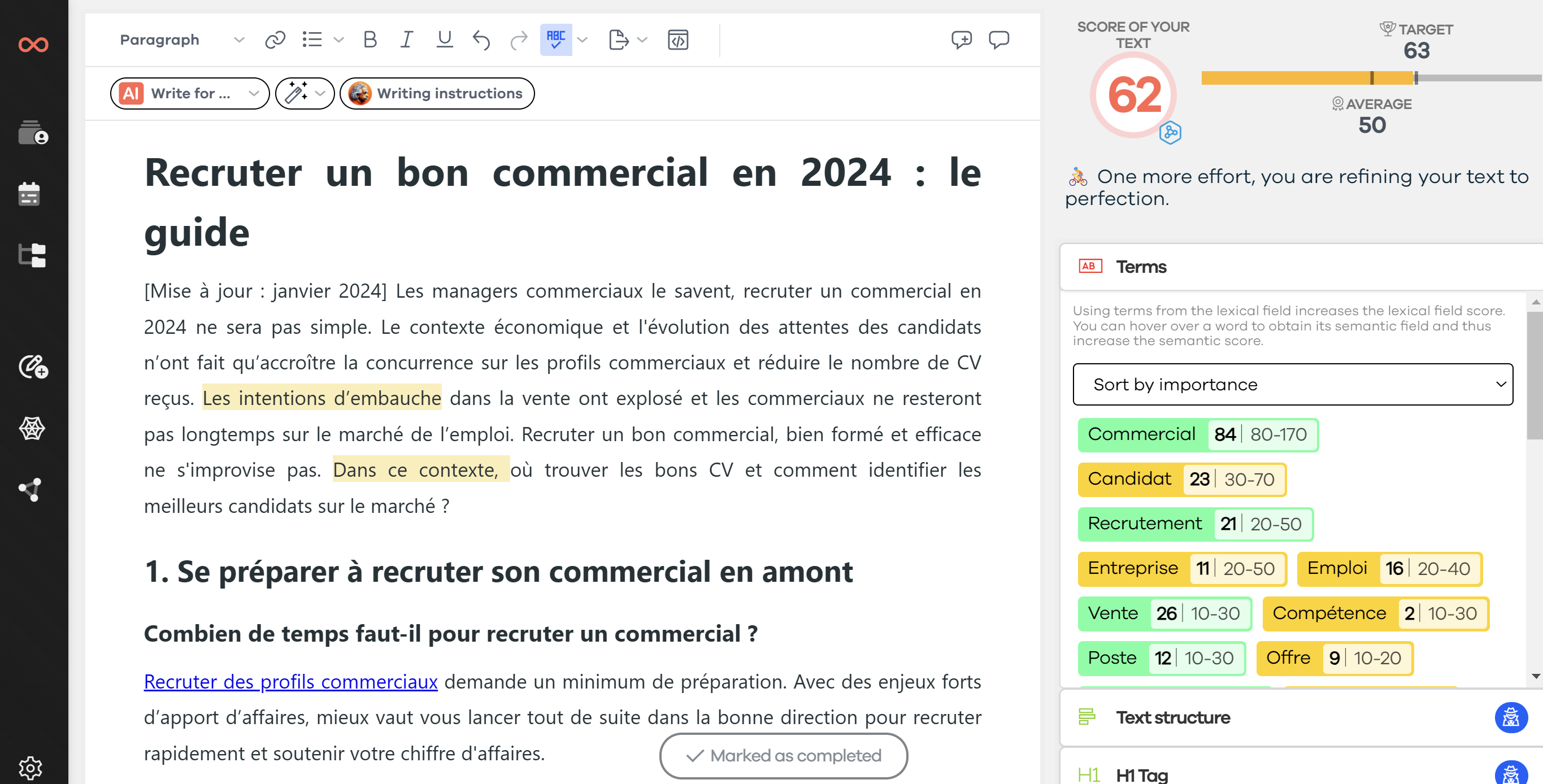

Le bourrage de mots-clés est mort depuis longtemps, mais sa version IA existe : des articles qui « cochent toutes les cases » sémantiques sans apporter de substance. L'optimisation sémantique intelligente — analyser l'intention de recherche, couvrir les sous-sujets pertinents, structurer pour la compréhension — est ce qui fait la différence.

C'est exactement ce que fait un outil comme SEOQuantum : Albert analyse l'intention de recherche et les lacunes sémantiques de votre contenu, puis suggère des améliorations ciblées. L'IA optimise ; l'humain décide.

Règle 5 — Mesurez la qualité, pas le volume

Les métriques qui comptent ne sont pas « combien d'articles publiés ce mois-ci » mais :

- Taux de conversion par article

- Temps moyen passé sur la page

- Position moyenne par cluster thématique

- Taux de citation dans les AI Overviews

Un article de qualité vaut mieux que dix articles médiocres — et c'est encore plus vrai depuis que les AI Overviews captent la majorité des clics informationnels.

6. Et SEOQuantum dans tout ça ?

Transparence totale : SEOQuantum utilise l'IA. Albert, notre assistant intégré, aide à optimiser les contenus. Nous pratiquons ce que nous prêchons — et voici pourquoi ce n'est pas contradictoire.

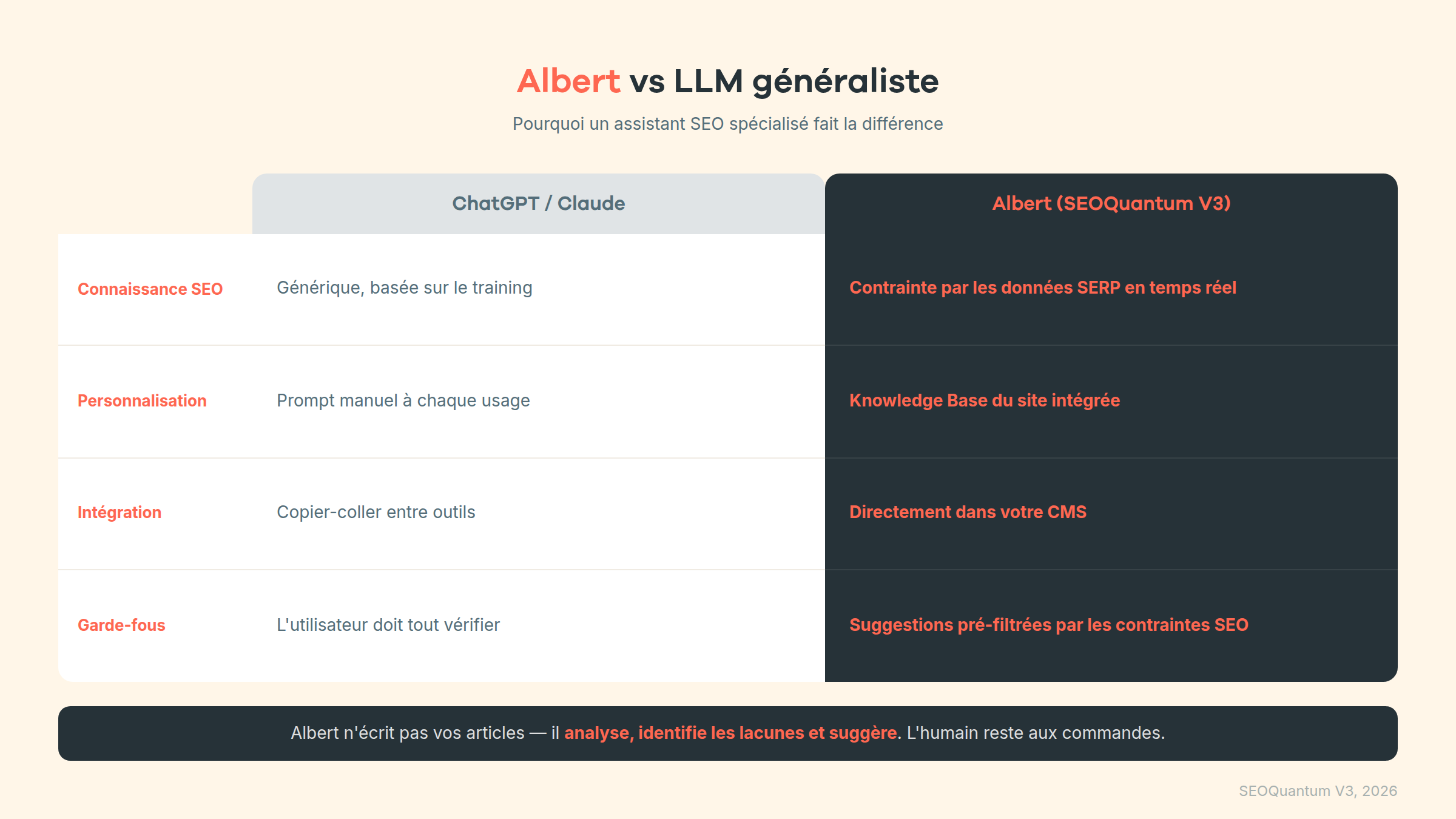

Albert ≠ ChatGPT

La différence entre Albert et un LLM généraliste est structurelle :

| Dimension | ChatGPT / Claude | Albert (SEOQuantum) |

|---|---|---|

| Connaissance SEO | Générique, basée sur le training | Contrainte par les données SERP en temps réel |

| Personnalisation | Prompt manuel à chaque usage | Knowledge Base du site intégrée |

| Intégration | Copier-coller entre outils | Directement dans votre CMS |

| Garde-fous | L'utilisateur doit tout vérifier | Suggestions pré-filtrées par les contraintes SEO |

Albert n'écrit pas vos articles à votre place. Il analyse ce que Google attend sur une requête donnée, identifie les lacunes de votre contenu, et suggère des optimisations précises. L'humain reste aux commandes.

Le dogfooding

Cet article lui-même a été rédigé avec assistance IA, puis enrichi de données sourcées, structuré pour l'intention de recherche « contenu IA Google », et relu par un expert SEO. C'est exactement le workflow que nous recommandons — et que notre audit E-E-A-T permet de valider.

Conclusion : l'IA n'est pas le problème — la médiocrité l'est

En 2026, le débat « contenu IA vs contenu humain » est obsolète. Google l'a tranché : la qualité prime sur la méthode de production. Les détecteurs IA sont des passoires. SpamBrain cible la basse qualité systématique, pas la technologie utilisée.

Ce qui fera la différence pour votre SEO :

- Expertise démontrée : données propriétaires, études de cas, expérience terrain

- Sources fiables : chaque affirmation étayée par une référence vérifiable

- Utilité réelle : répondre à l'intention de recherche, pas juste cibler un mot-clé

- Revue humaine : l'IA produit un premier jet, l'expert le transforme en contenu de valeur

L'IA est un outil. Comme un traitement de texte ou un correcteur orthographique avant elle, elle augmente la productivité sans remplacer l'expertise. La question n'est plus « faut-il utiliser l'IA ? » mais « comment l'utiliser pour produire du contenu qui performe ? ».

SEOQuantum est conçu pour ça : Albert analyse, suggère et optimise. Vous validez, enrichissez et publiez.

Sources : Google Search Central, Stanford University, Originality.ai, Google Quality Rater Guidelines (sept. 2025), TechPolicy.press

Need to go further?

If you need to delve deeper into the topic, the editorial team recommends the following 5 contents:

- Redaction.io : le meilleur allié des rédacteurs web SEO ?

- Conseils et astuces pour devenir plus productif à l'écrit

- Logiciel anti plagiat gratuit : lequel est le plus fiable ?

- Plateforme de rédaction web : la solution pour avoir du bon contenu ?

- Logiciel de rédaction automatique : comment faire son choix ?